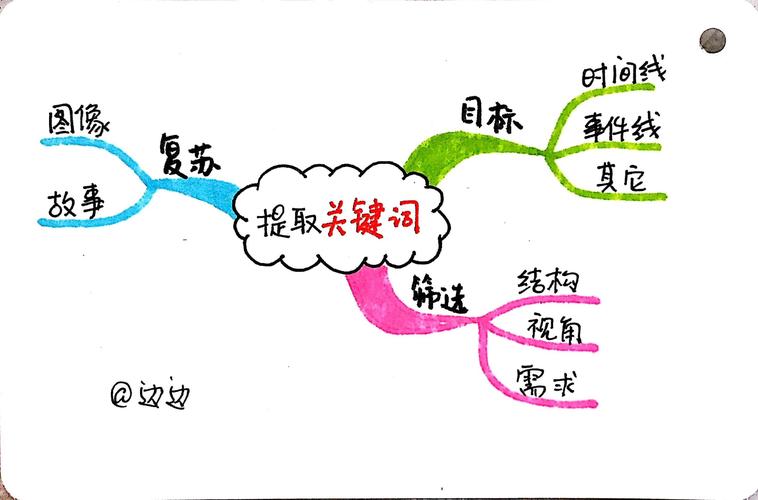

如何给文章取一个标题,要贴近文章主题那种?如何给文章提取关键词?纵然你能一目十行,过目不忘,也比不上机器“一幕十篇”。接下来先容一个python项目,经由笔者的改造后,可以方便学习和利用,它能很好、很快地提取文章关键词。

先喝杯咖啡,让我们开始python之旅

环境配置

python版本: 3.6.0

编辑器: pycharm

项目所须要的环境安装包

pip install jiebapip install bs4

第一步:导入干系的python包

# encoding:utf-8import jiebaimport jieba.analyseimport jieba.posseg as psegfrom bs4 import BeautifulSoup

jieba: 这是一个处理中文分词工具包。实在它并不是只有分词这一个功能,而是一个开源框架,供应了很多在分词之上的算法,如关键词提取、词性标注等。可以说是做人工智能一个必备的python包。

bs4: 它的浸染是能够快速方便大略的提取网页中指定的内容,给我一个网页字符串,然后利用它的接口将网页字符串天生一个工具,然后通过这个工具的方法来提取数据。爬虫工程师会常常用到这个包,这里作为一个数据洗濯的包利用。

第二步:参数配置类class CONF: stopwords_path = './data/stopwords.txt' mydict_path = './data/mydict.txt' top_n = 10 # 只取10个关键词

参数配置类: 文件路径、模型存放路径、模型参数统一放在一个类中。值得把稳的是,实际项目开拓的时候,是用后缀名为config 文本文件存放,不会直接写在代码里。这里为了演示方便,就写在一起,也方便运行。这块代码放在代码文件的开头也方便查看和修正。stopwords_path 是一个停用词库的相对路径。mydict_path 是一个词典路径,词典里紧张存放一些网络名词和一些 jieba 分词识别不出的新词汇。

第三步:类的初始化class KeyWordModel: def __init__(self, stopwords_path, mydict_path, top_n): self.stopwords_path = stopwords_path self.mydict_path = mydict_path self.top_n = top_n # 加载停用词 分外词典 jieba.analyse.set_stop_words(self.stopwords_path) jieba.load_userdict(self.mydict_path) """模型初始化""" @classmethod def initialize(cls, config): stopwords_path = config.stopwords_path mydict_path = config.mydict_path top_n = config.top_n return cls(stopwords_path, mydict_path, top_n)

initialize() 函数和 __init__() 函数 是工具初始化和实例化,个中包括基本参数的赋值、末了返回用户一个工具。这里作为一个类的基本操作,是属于一个通用模板,在大多数项目中,都可以这么去写。为了养成良好的编程习气,大家可以把这个模板记下来,后续直接套用,修正部分参数就可以了。jieba.analyse.set_stop_words() 和 jieba.load_userdict() 分别是导入停用词和导入自己构建的词汇,这里放在__init__() 函数中,类被实例化的时候,只被调用一次。

第四步: 类的主流程函数"""获取关键词"""def get_keyword(self, content): text_rank_word = self.__tf_idf_key_word(content) tf_idf_word = self.__textrank_key_word(content) word_list = list(set(text_rank_word).union(set(tf_idf_word))) result = self.__filter_pos_key_word(word_list, content) return result

在写代码的时候,一定要捉住主线,便是代码运行的主流程。由于一个完端赖得住的项目,它是有很多细枝末节考虑,很多步骤是要分模块来写。主流程便是把主心干确定好,各个模块的入口确定好。这样开拓的时候,思路会比较清晰,不会被细节吸引住。这里主心干只有个函数 get_keyword() 的调用,个中text_rank_word 、tf_idf_word 分别用textrank 和tfidf算法提取关键词,末了再用词性过滤器__filter_pos_key_word(), 提取名词关键词。

第五步: 提取关键词的三个方法"""TF-IDF 提取top_n个关键词"""def __tf_idf_key_word(self, content): sp = BeautifulSoup(content, "html.parser") tags = jieba.analyse.extract_tags(sp.text, topK=self.top_n) return tags"""TextRank 提取top_n个关键词"""def __textrank_key_word(self, content): sp = BeautifulSoup(content, "html.parser") tags = jieba.analyse.textrank(sp.text, topK=self.top_n) return tags"""只获取名词"""def __filter_pos_key_word(self, tag_list, content, pos_list=['n', 'nr', 'ns', 'nt', 'nrt']): sp = BeautifulSoup(content, "html.parser") words = pseg.cut(sp.text) list_tmp = [] for w in words: word = w.word if w.flag in pos_list and len(word) > 1 and word not in list_tmp and word in tag_list: list_tmp.append(word) return list_tm

TF-IDF: 这是一个常用的提取关键词算法,利用文章中词频越高主要性越高、和逆词频(该词在其他文章词频越低越能代表本文章)。

TextRank: 有点像PageRank 算法,感兴趣的朋友可以理解一下,这里不过多先容有难度的算法。

pseg: 这是一个词性解析器,它能够剖析句子中每个词语的属性,例如:名词、动词、形容词等。

第六步: 主函数入口末了,测试一下

用我之前写的《最近很火的文章自动天生器,python源码公开了(内附python代码)》,来天生随机一篇文章标题为《标题党》的文章,作为程序的输入,运行结果:

关键词: ['标题党', '事实', '缺陷', '寻思', '角度', '能力', '梦想']

如果有疑问想获取源码, 可以在后台私信我,回答:python关键词。 我把源码发你。末了,感谢大家的阅读,祝大家事情生活愉快!