但实际上对抗样本并不仅仅存在于图像领域,在其他系统中也面临对抗样本攻击的风险。本文就会先容视频领域以及音频领域的对抗样本攻击,包括相应的saliency frame attack,PGD attack等技能,同时通过直接的视频压缩、音频压缩进行防御。

攻击视频动作识别(video action recognition )系统我们利用UCF101数据集,UCF101是从YouTube网络的真实动作视频的动作识别数据集,有101个动作种别,共13320个视频,UCF101在动作方面有很大的多样性,并且在相机运动、物体外不雅观和姿势、物体尺度、视点、凌乱背景、照明条件等方面存在较大变革,它是最迄今为止具有寻衅性的数据集。101个动作类别的视频分为25组,每组可以包含4-7个动作视频。来自同一组的视频可能具有一些共同的特色,例如相似的背景、相似的视点等我们针对个中篮球动作的一小段视频进行实验。视频如下

首先我们先准备好待会儿会用到的函数

由于演习比较费时,而且不是本文的重点,以是我们直接加载其他人已经预演习好的模型

查看模型对篮球动作的预测结果

可以看到以0.725的置信度将该动作识别为篮球。接着我们利用FGM进行攻击,攻击会毁坏视频样本,使其被缺点分类。FGM全称是Fast Gradient Method,随意马虎让我们想到FGSM(Fast Gradient Sign Method),实在FGM便是FGSM的变种,由于其攻击还扩展到了其他范数,以是称之为FGM,其代码实现如下

接着让模型预测对抗样本

可以看到,已经预测失落败了,乃至top-5里面都没有篮球这个方法我们在面对图像的对抗样本中也见过。接下来我们运用基于帧显著图(frame saliency)的方法来进行攻击,我们将帧按照显著性递减的顺序进行扰动我们将帧的显著性定义为

个中,H 和 W 分别表示视频帧的空间高度和宽度。 换句话说,这个显著标量是关于单个帧梯度的均匀幅度。这个观点实在是受到Simonyan等人的启示,他们指出“利用类分数导数的图像特定类显著性表明了对图像的哪些像素变动最少能对类分数影响最大”,这种攻击背后的直觉是,通过迭代扰动对预测结果最敏感的视频帧(即上面公式打算得到的有高均匀显著性的帧),我们可以制作稀疏扰动的对抗样本。代码实现如下

我们可以直接指定对某一帧进行扰动,如下所示

从预测结果可以看到,排在第一位的是打网球,不过打篮球排在第二位由于对抗样本返回时是数组形式,我们可以将其保存成gif格式

保存后的gif如下所示

这个对抗样本和原来的视频我们人眼当然是看不出差异的那么应对这种防御,有没有什么防御技能呢?最大略的办法便是在预处理层面做防御,直接对视频做压缩,基于 H.264/MPEG-4 AVC进行视频压缩防御。视频压缩的基本事理便是去除图像的冗余信息。同一张图像内会有很多冗余的区域,视频的图像序列之间也有很多冗余的区域,视频的帧率越大,冗余度会越大。当然,我们在这里进行压缩的目的是为了去除对抗样本中添加的额外扰动。实在当代码如下

运用后的结果如下

可以经由视频压缩,不论是原视频还是对抗样本都以最高的置信度被分类为了篮球,解释该防御技能是有效的。

攻击音频识别(speech recognition)系统我们利用的数据集是AudioMNIST,该数据集由60个不同说话人的30000个语音数字(0-9)的音频样本组成。每个说话人都有一个保存自己录音的目录。首先下载数据集及在其上预演习好的模型

由于涉及到音频,以是还须要准备好后面会用到的赞助函数

然后加载测试集以及模型

接下来该发动攻击了,但是怎么对音频旗子暗记发动攻击呢?对抗样本的本色便是在特色空间添加扰动,那么对付音频旗子暗记,我们可以考虑在其频谱特色x上添加扰动,如下所示

个中,足够小,以至于扰动版本的x~重修得到的音频旗子暗记对付人类而言与x是无法区分的,但是却可以欺骗模型做出误分类的结果。如何找到一个得当的可以形式化为求解下面的优化问题

个中,loss是丢失函数,是模型参数,是x的标签,是许可扰动的凑集,表征着攻击者的能力。我们可以设为一个小的-ball,即

我们可以运用PGD办理此优化问题。PGD是一种迭代的方法,从原始输入开始,输入根据下式进行迭代更新

个中,是步长,K是迭代次数,clip()函数用于逐元素裁减以知足

我们将作为终极得到的扰动的频谱特色。PGD的代码实现如下

清楚攻击方案后,我们来进行实践。加载一个测试样本,并运用PGD天生对抗样本,然后利用模型分别预测这两个样本查看其预测结果

可以看到原样本被预测为了1,而对抗样本被预测为了9,解释对抗样本攻击成功了打印出他们的波形看看

可以波形基本类似,同时听音频也听不出差别来。可以换个测试样本看看

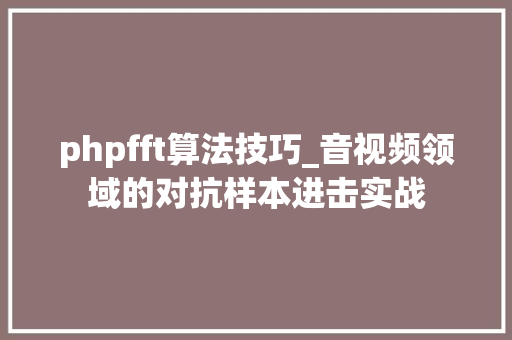

模型将原样本预测为8,将相应的对抗样本预测为3,解释对抗样本攻击成功了打印其波形

可以看到波形上差异不出来,听音频也无法区分面对这种攻击怎么防御呢?我们可以运用最直不雅观的MP3压缩技能进行防御。MP3压缩的事情事理是降落(或靠近)某些声音身分的准确度,这些声音身分(通过生理声学剖析)被认为超出了大多数人的听力能力。这种方法常日被称为感知编码或生理声学建模,然后利用MDCT和FFT算法以节省空间的办法记录剩余的音频信息,实质上便是去除冗余。当然,我们运用mp3压缩的目的是为了在保持音频结果精确的同时去除对抗样本中添加的扰动。其代码实现如下

将mp3防御运用于原样本和对抗样本

可以看到模型此时对两个样本的预测都是8,解释我们的防御方法生效了。

参考1.https://www.crcv.ucf.edu/data/UCF101.php2.https://github.com/soerenab/AudioMNIST3.On Evaluating Adversarial Robustness4.ADVERSARIAL ATTACKS FOR OPTICAL FLOW-BASED ACTION RECOGNITION CLASSIFIERS5.ADVERSARIAL ATTACKS ON SPOOFING COUNTERMEASURES OF AUTOMATIC SPEAKER VERIFICATION6.Audio Adversarial Examples: Targeted Attacks on Speech-to-Text7.https://en.wikipedia.org/wiki/MP38.https://zh.wikipedia.org/zh/H.264/MPEG-4_AVC9.https://github.com/carlini/audio_adversarial_examples10.https://github.com/roiponytch/Flickering_Adversarial_Video

本文由whoami原创发布 转载,请参考转载声明,注明出处: https://www.anquanke.com/post/id/258566 安全客 - 有思想的安全新媒体